È stato pubblicato recentemente l’usuale l’AI Index Report curato dall’università di Stanford, nella versione aggiornata del 2023, mirata su quanto emerso nel 2022. Permette di capire come tutto ciò che ruota attorno all’intelligenza artificiale (IA) sia in grande fermento, da vari punti di vista, come la ricerca e i finanziamenti, così come dal punto di vista dell’intervento regolatorio sempre più dilagante. Le enormi possibilità delle varie tecnologie in parola sono filtrate anche sotto la lente dei rischi e dei risvolti negativi, come dovrebbe avvenire con qualsiasi tecnologia – e tanto più con la portata esponenziale che sta dimostrando di possedere l’AI in questi ultimi mesi.

Il report di Stanford è uno strumento noto da anni agli operatori del settore, e non solo, nel presentare uno spaccato attendibile e sfaccettato dei trend e di cosa stia accadendo, nel mondo, se si parla di intelligenza artificiale (focalizzandosi soprattutto sul machine learning e tecniche similari). Viene curato da un Committee interdisciplinare di esperti, sia accademici che dell’industria, e segnaliamo che – pur approcciando un contesto globale – il documento è prevalentemente incentrato sul quadro statunitense, quello più fervido (nel mondo occidentale) sul campo.

Nelle intenzioni dichiarate, il report AI Index 2023 vuole “tracciare, raccogliere, distillare e visualizzare i dati relativi all’intelligenza artificiale“. La missione di Stanford qui è fornire dati imparziali – “rigorosamente controllati e di ampia provenienza“ – in modo che “politici, ricercatori, dirigenti, giornalisti e il pubblico in generale possano sviluppare una comprensione più approfondita e sfumata del complesso campo dell’IA“. Mira a essere la fonte più credibile e autorevole al mondo per dati e approfondimenti sul tema, rendendo pubblici molti dei dati di studio utilizzati.

Il documento complessivo si compone di quasi 400 pagine, qui si vogliono accennare alcuni dei passaggi più interessanti emersi dalla consultazione. Non si può che invitare alla lettura del testo completo, delle sue sezioni d’interesse, a seconda del lettore.

Indice degli argomenti:

I 10 punti principali dell’AI Index 2023

La struttura del report è articolata per macro-argomenti, tra i quali troviamo:

- R&D

- performance tecniche

- etica dell’ai

- aspetti economici

- istruzione

- diversità

- opinione pubblica

- policy & governance.

Nel decalogo riassuntivo del report si condensano i risultati più importanti (positivi e negativi) ottenuti dallo studio, svolto “sul campo” utilizzando sondaggi, interviste, analisi, altri studi, ecc. Emerge quanto segue:

- Il settore privato dell’AI ha preso il sopravvento sul mondo accademico nella produzione dei modelli di machine learning più significativi; dal 2014 si è notata questa inversione di tendenza, arrivando al 2022 in cui si sono registrati più di trenta significativi modelli di apprendimento automatico prodotti dal settore privato, rispetto ai soli tre realizzati dal mondo accademico. La creazione di sistemi di intelligenza artificiale all’avanguardia richiede sempre più grandi quantità di dati (i c.d. “big data“), potenza di calcolo e investimenti, tutte risorse prevalenti nel settore privato.

- L’AI continua a mostrare – misurati sull’anno – progressi marginali sui “benchmark” tecnici tradizionali, però nuove suite di benchmarking, più complete, stanno emergendo, per avere un quadro più preciso degli effettivi miglioramenti tecnici.

- L’AI può avere impatti ambientali negativi, tuttavia nuovi modelli di machine learning possono essere utilizzati per ottimizzarne l’impatto energetico. Secondo alcuni studi ad es. l’addestramento di un modello può comportare l’emissione di 25 volte più carbonio di quello impiegato da un singolo passeggero, in aereo, per un viaggio di sola andata da New York a San Francisco.

- L’AI sta accelerando rapidamente il progresso scientifico. Ne è dimostrazione il suo utilizzo negli studi sulla fusione dell’idrogeno, per generare nuovi anticorpi, ecc.

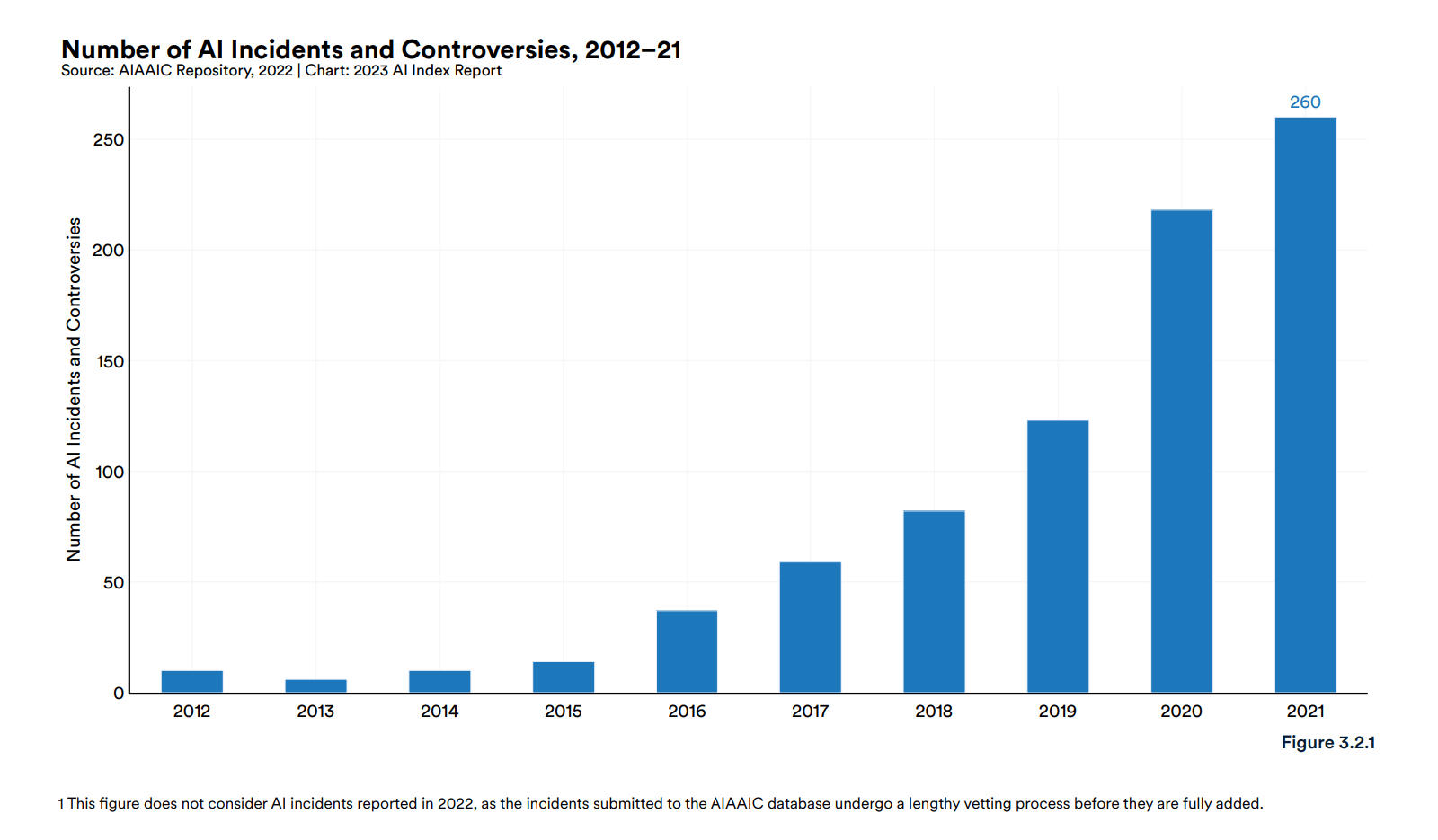

- Il numero di “incidenti” riguardanti l’uso improprio dell’AI è in rapido aumento. Secondo il database di ricerca indipendente AIAAIC – che tiene traccia degli incidenti legati all’uso etico improprio dell’AI – il numero di incidenti è aumentato di 26 volte dal 2012. Tra questi viene annoverato ad es. il video deepfake del presidente ucraino Zelensky che si arrendeva. Questa crescita comprova un crescente uso delle tecnologie di AI così come della consapevolezza del loro potenziale uso improprio.

- La domanda di competenze professionali legate all’AI è in aumento in tutto il mondo, negli USA colpisce in ogni settore industriale che coinvolga dati.

- Per la prima volta nell’ultimo decennio, gli investimenti privati del settore, così come il numero di nuove società dedicate all’AI – se confrontati da anno ad anno –, a sorpresa sono diminuiti. Nel 2022 sono ammontati a circa 90 miliardi di dollari, in calo di circa il 26% rispetto al 2021. Tuttavia, se letti nell’arco di un decennio nel suo complesso, gli investimenti nell’AI sono aumentati in modo significativo: nel 2022 la quantità di investimenti privati nell’AI è stata 18 volte maggiore rispetto al 2013.

- La proporzione di aziende che adottano l’AI (tra il 50 e 60% sul totale) si è stabilizzata, pur continuando ad aumentare le aziende che hanno adottato l’AI. Le aziende che l’hanno implementata riferiscono di aver beneficiato di riduzioni significative dei costi e di aumenti dei ricavi.

- L’interesse politico per l’AI e la sua regolamentazione sono in aumento, su scala globale.

- I cittadini cinesi sono i più positivi nei confronti dei prodotti e dei servizi utilizzanti l’AI.

In un sondaggio del 2022 risulta che il 78% degli intervistati cinesi vede nell’uso dell’AI più vantaggi che svantaggi. Mentre solo il 35% degli statunitensi intervistati la pensa così, essendo perlopiù dubbiosi o pessimisti sul tema.

Etica dell’AI

Il report AI Index 2023 affronta nel capitolo 3° il “lato oscuro” dell’impiego di queste tecnologie, sul piano etico. L’utilizzo tecnologico, in generale, ha sempre degli inevitabili effetti e risvolti etici da ponderare, oggi sempre più evidenti a livello mondiale proprio per le grandi capacità dimostrate dall’AI. In sostanza, il report evidenzia i seguenti punti di attenzione, tra i tanti:

• Si producono modelli di grandi dimensioni, addestrati su dati proprietari, che risultano sempre viziati da bias e distorsioni insiti negli stessi dataset. Tuttavia, questi problemi potrebbero essere mitigati, almeno in parte, dopo aver addestrato questi modelli con tecniche di ottimizzazione delle istruzioni.

• I modelli “generativi” di AI (cioè produttivi di contenuti artificiali, di quelli che alcuni chiamano “media sintetici“) sono ormai diffusissimi tra il pubblico – basti menzionare i noti ChatGPT, DALL-E, Midjourney, ecc. Recando con sé i propri specifici problemi etici, ora avvertibili da una vasta platea. Lo studio afferma che nel 2022 questi modelli “sono diventati parte dello zeitgeist” e possono produrre “effetti nefasti” a livello sociale.

- In particolare, si menziona ChatGPT e il tentativo di mitigare i rischi che ne derivano. Preso atto che immaginare tutti i possibili scenari di attacco, in questo ambito, è impossibile, si prefigura per i ricercatori uno scenario “gatto e topo” potenzialmente infinito e inquietante: “gli sviluppatori di AI cercano di implementare contromisure in anticipo, gli utenti finali cercano di infrangere il sistema e aggirare le sue policy, allora gli sviluppatori correggono le lacune una volta emerse, e via così ad libitum“.

• Un’analisi approfondita dei modelli linguistici (ovvero: impieganti tecniche statistiche e probabilistiche per comprendere e generare testi) suggerisce che – sebbene esista una chiara correlazione tra prestazioni ed equità (“fairness“) – “equità e bias possono essere in contrasto“: cioè i modelli linguistici, che ottengono risultati migliori circa determinati parametri di equità, tendono ad avere più marcati pregiudizi di genere (gender bias).

• Il fact-checking automatizzato (cioè di verifica algoritmica della veridicità delle news), tramite elaborazione del linguaggio naturale, non risulta ancora affidabile: i ricercatori hanno scoperto che la maggioranza delle analisi e giudizi di alcuni modelli AI si basavano su “prove” rivelatesi inesistenti a una verifica umana successiva.

Si veda nel grafico seguente lo stato degli incidenti e delle controversie connessi all’uso di AI, sopra menzionato, inerente al periodo 2016-2022.

Policy & governance

Nel capitolo 6° il report AI Index 2023 si dedica al tema “Policy e governance“, pertanto ai risvolti di regolamentazione giuridica del fenomeno AI. In breve, emerge quanto segue:

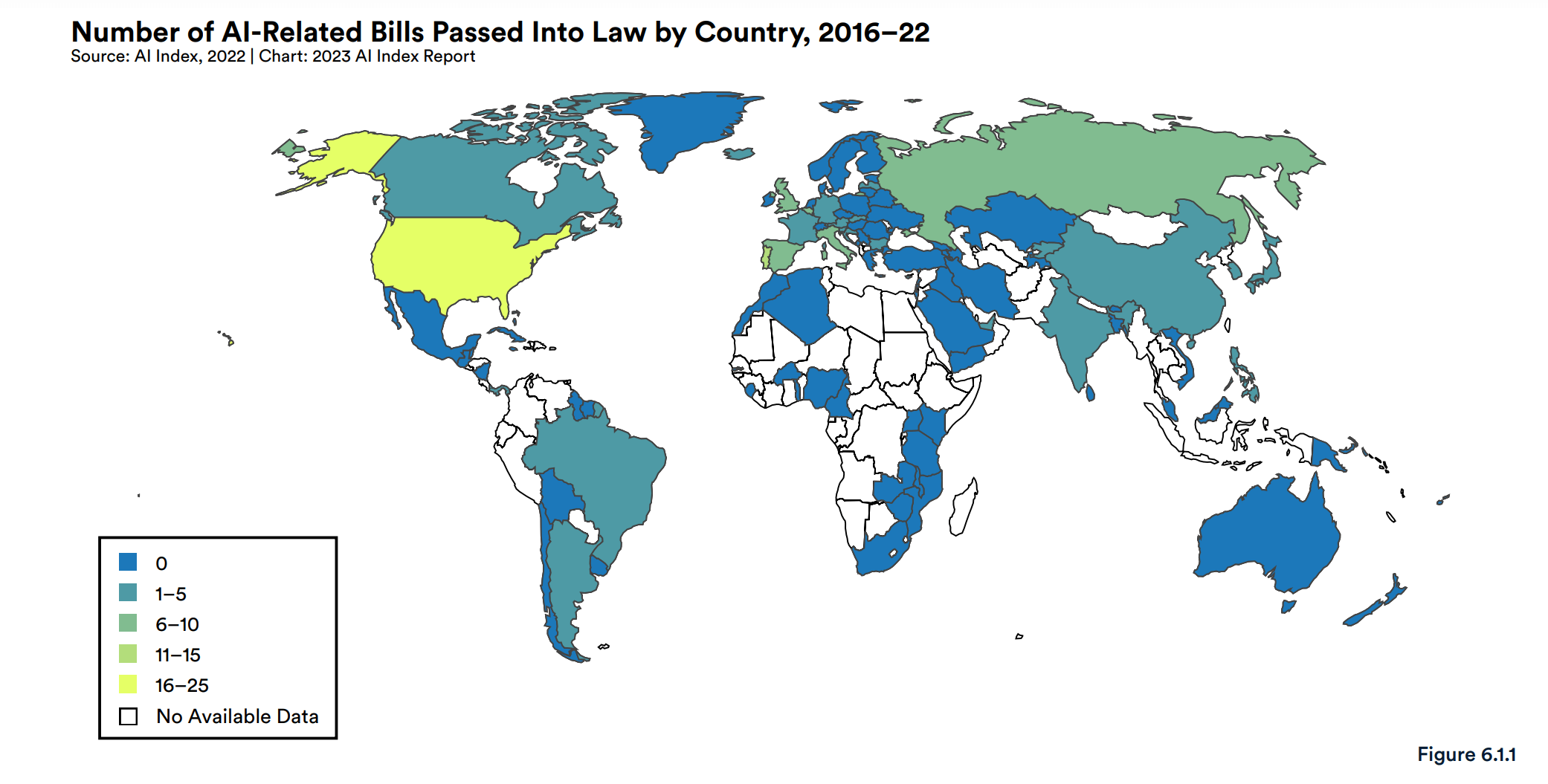

- L’interesse dei responsabili politici per l’AI è in aumento: un’analisi di 127 Paesi nel mondo mostra che il numero di provvedimenti normativi riguardanti “l’intelligenza artificiale” è cresciuto da solo 1 nel 2016 fino a 37 nel 2022.

- Gli Stati Uniti hanno approvato più leggi sull’AI che mai: nel 2022 il 10% delle proposte federali che toccano il tema AI sono divenute norme, nel 2021 era solo il 2%. A livello dei singoli Stati USA la percentuale è del 35%. Peraltro, Il governo degli Stati Uniti continua ad aumentare la spesa per l’IA, dal 2017 incrementata di circa 2,5 volte.

- I politici, nel mondo, stanno affrontano il tema da diversi punti di vista diversi e in ambiti molti differenti tra loro: ad es. “i legislatori del Regno Unito hanno discusso i rischi dell’automazione guidata dall’IA, quelli in Giappone la necessità di salvaguardare i diritti umani di fronte all’AI, in Zambia hanno esaminato la possibilità di utilizzare l’AI per le previsioni meteorologiche“.

- Parlando di contenzioso, nel 2022 negli USA si sono registrati circa sette volte più casi rispetto al 2016, e “la maggior parte di questi casi ha avuto origine in California, New York e Illinois e riguardava questioni relative al diritto civile, alla proprietà intellettuale e al diritto contrattuale“.

Il capitolo, come tutti, è ricco di grafici esplicativi, si veda il seguente sullo stato mondiale del numero di normative approvate e inerenti l’AI, dal 2016 al 2022.

Conclusioni

Anche da una prospettiva statunitense, guardando al mondo, con questo report si avvisano i naviganti che il fenomeno dell’AI sta correndo più veloce di molte previsioni. I benefici, attuali e potenziali, sono immensi, così come rischi ed effetti preoccupanti. La riflessione etica e giuridica, come si è visto, non può mancare ed è ormai diffusa a livello planetario: si dovrà vedere quante delle preoccupazioni esposte, note e dibattute da anni (restando in Europa, pensiamo ad es. ai contributi degli esperti di alto livello sull’etica dell’AI sfoceranno concretamente in procedure e atti normativi, in standard riconosciuti.

A livello europeo sono in ballo diverse proposte di regolazione sull’AI, in particolare l’ambizioso progetto di regolamento generale detto “AI Act” – stra-dibattuto e controverso – e la proposta di Direttiva sulla responsabilità civile dell’AI. I tempi non permettono di tergiversare oltre, come documenta il report di Stanford, se la strada che si vuole intraprendere è quella di tali proposte. Quest’anno sarà forse già troppo tardi per la loro approvazione.