L’intelligenza artificiale richiede nuove forme di gestione della fiducia, del rischio e della sicurezza che i controlli più convenzionali non consentono. Il concetto di AI TRiSM (Trust, Risk and Security Management), incluso da Gartner nella Top 10 Strategic Technology Trends per il 2023, implica lo sviluppo di soluzioni e tecniche di interpretabilità e spiegabilità di un modello, di modelOps, di protezione dei dati AI, e di resistenza alla minaccia di attacchi adversarial.

Indice degli argomenti:

AI TRiSM, human-centric AI

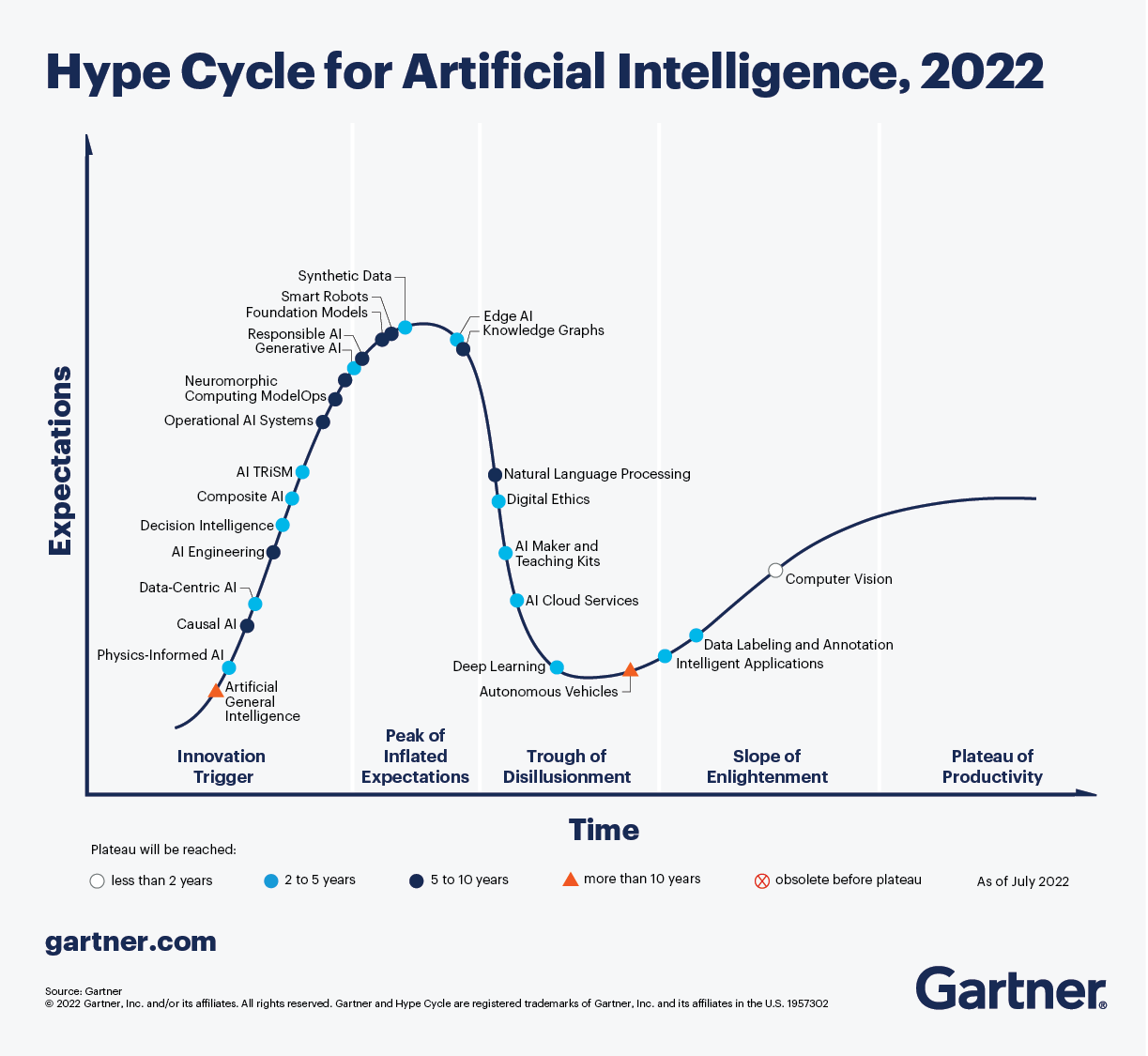

Nel modello Hype Cycle 2022 focalizzato sull’AI di Gartner l’innovazione dell’AI TRiSM rientra nella categoria AI Antropo-centrica. Si tratta di un approccio che mira a sviluppare sistemi AI che tendono ad aumentare e ad amplificare le capacità umane invece che sostituirle con l’attività della macchina intelligente.

Più in generale, si definisce l’AI TRiSM come un framework in grado di supportare governance, affidabilità, equità, robustezza, efficacia e privacy del modello AI.

Secondo Gartner – in un quadro in cui entro il 2028 le macchine basate sull’AI rappresenteranno il 20% della forza lavoro globale e il 40% della produttività complessiva – le aziende che porteranno avanti un programma basato sui concetti dell’AI TRiSM, incentrata su trasparenza, fiducia e sicurezza verranno premiate dal mercato. Perché i loro modelli AI avranno risultati migliori (in una percentuale stimata di più 50%) in termini di adozione, obiettivi di business e accettazione da parte dell’utenza.

Viceversa, le organizzazioni che non adotteranno misure più incisive per gestire rischi e problematiche potrebbero andare incontro a gravi danni alla reputazione, a importanti perdite economiche e malfunzionamenti dei sistemi AI.

Fiducia e AI

Fino a che punto arriva la fiducia nei sistemi AI sia in ambito aziendale sia quando ha impatto nella sfera personale?

Man mano che algoritmi e sistemi AI diventano più complessi e diffusi la fiducia assume una valenza maggiore e si trasforma in una priorità, secondo quanto evidenzia l’IBM Global AI Adoption Index 2022.

In un sondaggio realizzato da Ipsos per conto del World Economic Forum, con interviste in 28 paesi, è emerso che circa il 60% delle persone interpellate ha dichiarato di aspettarsi un cambiamento profondo sulla loro vita dovuto a prodotti e servizi connessi all’uso dell’AI. Ma soltanto il 50% ha affermato di fidarsi delle aziende che utilizzano applicazioni e sistemi AI allo stesso modo delle aziende che non ne fanno uso.

L’indagine Ipsos indica una chiara correlazione tra la fiducia e tra la trasparenza e la comprensione dei meccanismi AI. Fiducia e trasparenza in ambito AI, che si cerca peraltro di garantire by design, rimandano al principio di spiegabilità. Nel cui quadro si prevede che capacità e finalità dei sistemi di AI siano comunicati apertamente e le decisioni, per quanto possibile, debbano poter essere spiegate a coloro che ne sono direttamente o indirettamente interessati.

Anche nella ricerca svolta da IBM, in collaborazione con Morning Consult, viene confermato il fatto che i consumatori sono propensi ad apprezzare l’attitudine di un’azienda a essere trasparente riguardo a come i sistemi AI vengono realizzati, gestiti e utilizzati.

D’altra parte, rappresenta un fattore importante per il business riuscire a spiegare in modo chiaro la ragione e le modalità con le quali l’AI arriva a produrre decisioni differenti.

Nell’ottica dell’AI TRiSM la fiducia è un obiettivo chiave da perseguire. Oltre tutto, come sottolinea la Commissione Ue, “la fiducia è una condizione indispensabile per assicurare un approccio antropocentrico all’AI”.

L’AI è sempre più oggetto di regolazione normativa ma le aziende dovrebbero spontaneamente implementare protocolli e pratiche che siano in grado di assicurare fiducia, trasparenza e protezione dei consumatori.

Le sfide per costruire e rafforzare l’aspetto della fiducia nell’AI sono diverse e a vari livelli. Secondo IBM, costituiscono un problema la mancanza di formazione e di skill per indirizzare i modelli AI verso trasparenza e fiducia, strumenti di gestione che non funzionano in tutti gli ambienti, il deficit di spiegabilità dei risultati AI (anche per i fornitori), la mancanza di linee guida aziendali in tema di etica e affidabilità AI, mancanza di norme e linee guida implementate da governi o di settore, creazione di modelli AI sviluppati su dati che al loro interno presentano bias, deficit di strategia AI.

Strategia AI TRiSM

Sotto quest’ultimo aspetto, in una logica AI TRiSM è richiesta una strategia su più fronti in grado di affrontare rischi e minacce avendo come obiettivi cruciali le aree di explainability, protezione dei dati, modelOps, rilevamento di anomalie nei dati, e resistenza agli attacchi adversarial.

A questo scopo, per essere implementata l’AI TRiSM necessita la creazione e la collaborazione di un team multidisciplinare. Ciò include uno staff di settori quali IT, sicurezza, compliance, e data analytics. Costruire un gruppo ad hoc di questa natura, o se possibile una task force, potrebbe garantire migliori risultati.

Stato ed evoluzione del mercato dell’AI TRiSM

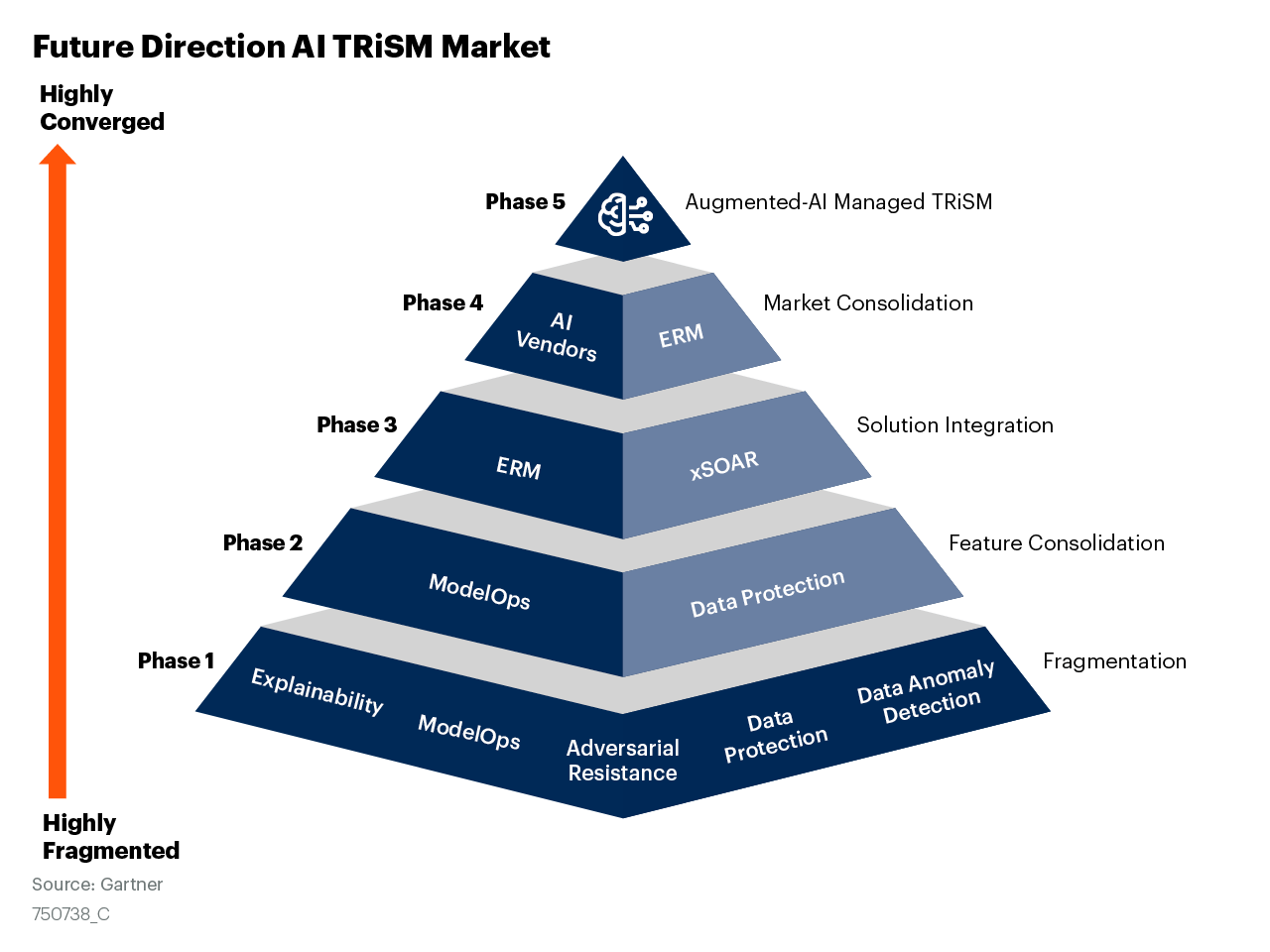

Allo stato attuale, il mercato dell’AI TRiSM, stando all’analisi elaborata dalla Gartner Market Guide, risulta fortemente frammentato. In questa prima fase, gli utenti sono costretti a ricorrere a più fornitori e piattaforme che non offrono soluzioni complete e integrate rispetto ai vari rischi e alle molteplici problematiche.

Ma il mercato, secondo Gartner, è destinato, col passare del tempo, a una rapida evoluzione, articolandosi in cinque diverse fasi di sviluppo. In una seconda fase, ci si aspetta un consolidamento soprattutto della parte relativa a modelOps e data protection mentre i fornitori cereranno dei veri e propri pacchetti di funzionalità di AI TRiSM. Nella terza fase, si assisterà a una integrazione delle soluzioni AI TRiSM nei modelli di gestione esistenti per poi passare a una quarta fase di consolidamento del mercato in cui si vedrà l’emergere di piattaforme di Enterprise Risk Management che s’imporranno. Mentre la quinta e ultima fase sarà quella dell’Augmented-AI Managed TRiSM in cui ci saranno nuovi sistemi AI TRiSM end-to-end.

È chiaro che fin quando non giungerà a questo livello di sviluppo le aziende dovranno servirsi di una serie di strumenti e pratiche per mettere in moto un processo di AI TRiSM. Gartner sottolinea come alcune piattaforme di modelOps già oggi includono funzioni di explainability o di controllo di anomalie di dati sebbene non riescano a rilevare le fonti.

Sarebbe utile, a questo riguardo, che i manager stabiliscano delle priorità in rapporto alle specificità dei settori nei quali operano le loro aziende. Nella sanità, per esempio, si potrebbe più importanza alla protezione dei dati mentre nel comparto difesa alle minacce di attacchi adversarial.

Conclusioni

L’AI TRiSM è una tendenza emergente che mira a rendere più sicuri ed efficaci i modelli AI di fronte alle minacce e vulnerabilità AI continue e in costante evoluzione. L’approccio AI TRiSM deve rappresentare uno sforzo continuo e non un esercizio una tantum delle aziende che potranno beneficiare dei migliori risultati in termini di adozione, obiettivi di business e accettazione dei sistemi AI.