Sono 49,86 i miliardi di euro che il PNRR – Piano Nazionale di Ripresa e Resilienza – destina al rilancio della competitività e produttività nel nostro Paese. Con la “Missione”: M1C1 – digitalizzazione, innovazione, sicurezza nella P.A.; digitalizzazione, innovazione e competitività nel sistema produttivo, nella cultura e nel turismo l’Europa e l’Italia vogliono intervenire in quei settori che sono stati individuati come fondamentali, in modo da dare impulso allo sviluppo e all’economia, rilanciandole, dopo la fase di decrescita e stagnazione subita per la pandemia di cui ancora stiamo subendo gli strascichi e tra questi non può non essere compresa la promozione della digitalizzazione e l’AI. È questo il quadro della normativa sull’AI e in cui l’Italia ha adottato il Programma Strategico per l’Intelligenza Artificiale – IA- 2022/2024. Il piano è frutto della sinergia tra il ministero dell’Università e della Ricerca, il ministero per lo Sviluppo economico e il ministero per l’Innovazione tecnologica e la transizione digitale e del contributo fornito dal gruppo di lavoro sulla Strategia nazionale per l’intelligenza artificiale, di cui fanno parte Barbara Caputo, Isabella Castiglioni, Marco Conti, Rita Cucchiara, Juan Carlos de Martin, Fosca Giannotti, Giuseppe Magnifico, Michela Milano e Giovanni Miragliotta. Facciamo il punto sullo stato della normativa sull’AI in Europa e in Italia.

Indice degli argomenti:

Normativa sull’AI: lo scenario europeo

Nell’ambito della Strategia europea per l’Intelligenza artificiale la Commissione nel 2021 ha pubblicato la Proposta di Regolamento sull’approccio europeo all’Intelligenza Artificiale (COM – 2021 – 206 final) che valuta i rischi dell’AI, con la finalità di salvaguardare i valori e i diritti fondamentali dei cittadini UE unitamente alla sicurezza degli utenti dei servizi resi dalle amministrazioni e istituzioni UE, fornendo il primo quadro giuridico definito europeo sull’AI, il Piano coordinato sull’Intelligenza Artificiale (COM – 2021 – 205 final), che dovrà rafforzare l’adozione dell’AI, gli investimenti e l’innovazione in tema di IA nella UE e il Libro Bianco sull’Intelligenza Artificiale: un approccio europeo all’eccellenza e alla fiducia .

In generale, nella proposta di regolamento si prevedono regole di trasparenza armonizzate applicabili a tutti i sistemi di AI, mentre sono previste specifiche disposizioni per i sistemi di AI classificati “ad alto rischio”, per i quali viene introdotta una specifica definizione, affinché rispettino determinati requisiti obbligatori relativi alla loro affidabilità.

Con l’intenzione di proporre nuove e più efficaci regole per far diventare l’Europa il cuore di tutto ciò che ruota intorno il mondo di un’AI efficiente e affidabile, la Commissione europea, ha destinato 292 milioni di euro alle tecnologie digitali e alla cybersicurezza. Spazi di dati, infrastruttura blockchain europea, corsi di formazione per competenze digitali avanzate, soluzioni digitali per servizi ai cittadini di qualità superiore, progetti pilota che indirizzano l’uso dell’intelligenza artificiale per combattere la criminalità.

Ma non solo: anche il settore sanitario in cui si metteranno a punto i sistemi di cybersicurezza, una realizzazione di centri così da dare supporto agli Stati membri per le consulenze giuridiche che semplifichino e agevolino l’attuazione della relativa legislazione. Questi saranno i principali obietti del finanziamento.

Tutto questo mediante l’invito della Commissione a presentare, nell’ambito del programma Europa digitale, le proprie proposte a cui faranno seguito l’adozione di programmi di lavoro. La scadenza per la presentazione degli inviti è stata fissata per il 17 maggio 2022.

Ciò si va ad aggiungere alla formulazione, in assoluto, del primo “Quadro giuridico completo” sulla AI, che ne affronta i rischi, individua i limiti e individua nell’Europa la guida a livello globale di tutto quanto ruota intorno l’AI, congiuntamente alla realizzazione di un nuovo “Piano coordinato con gli Stati membri”. Piano che intende garantire sicurezza, diritti fondamentali di persone e imprese, promuovendone l’adozione agli altri Stati membri e imprimendo impulso agli investimenti e all’innovazione dell’intelligenza artificiale in Europa.

L’obiettivo è di sfruttare le numerose opportunità che si nascono in questo mondo, affrontare le sfide, individuando e limitando i rischi notevoli per la sicurezza e la garanzia dei diritti fondamentali che il mondo dell’AI porta con sé.

A tutto questo si vanno ad aggiungere nuove regole per l’utilizzo di macchinari di AI, che andranno a integrare il rinnovato approccio UE per l’AI, plasmando le regole di sicurezza da adottare per l’Utilizzo di strumenti e macchine di AI così da aumentare la fiducia degli utenti per tutto quanto proviene e ruota intorno a questo mondo.

Ma sono l’acquisizione, ovvero la capacità di mettere in comune e condividere approfondimenti sulle politiche di AI, lo sfruttamento del potenziale dei dati, la promozione della capacità di calcolo critica a essere le azioni, individuate dalla Commissione, fulcro del Piano coordinato per agevolare l’utilizzo e la definizione di un contesto idoneo allo sviluppo e alla promozione dell’AI in Europa.

Contesto che dovrà essere il frutto della realizzazione di un quadro di governance e coordinamento efficiente e funzionante, che facilitino la realizzazione di sinergie e creino un’economia globale e dai fini condivisi. A tutto si vanno ad aggiungere “dati di grandi dimensioni”, di alta qualità e sicuri oltre a “un’infrastruttura di calcolo” che sia in grado di analizzare ed elaborare tali dati.

Sempre nella Strategia della UE sono incluse anche la Proposta di Regolamento sulle macchine, che stabilisce i requisiti di sicurezza dei prodotti , (COM – 2021 – 202 final) che va a sostituire l’attuale Direttiva Macchine n 2006/42/CE; la Comunicazione della Commissione al Parlamento europeo, al Consiglio, al Comitato economico e sociale europeo e al Comitato delle Regioni per la creazione di fiducia nell’Intelligenza artificiale antropocentrica (COM – 2019 – 168 final) del Gruppo ad alto livello sull’AI, pubblicate l’8 aprile 2019 per un’AI affidabile, per essere tale dovrebbe avere tre requisiti principalmente: essere legale ovvero conforme a tutte le leggi e normative applicabili, essere etica, ovvero garantire l’adesione a principi e valori etici e dovrebbe essere affidabile sia dal punto di vista tecnico che da quello dell’inserimento nel tessuto sociale ovvero dell’utilizzo da parte dei cittadini, in quanto una scarsa padronanza della tecnologia da parte degli utenti causerebbe danni anche in presenza di prodotti tecnologicamente eccellenti.

Il Rapporto sulla responsabilità per l’Intelligenza Artificiale e altre tecnologie emergenti del Gruppo di esperti sulla responsabilità e le nuove tecnologie pubblicato nel 2019 e la Dichiarazione di cooperazione sull’intelligenza artificiale firmata da 25 Paesi europei nel 2018 che si basa sui risultati e sugli investimenti della comunità europea della ricerca e delle imprese nell’AI, stabilendo le basi per il Piano coordinato sull’AI.

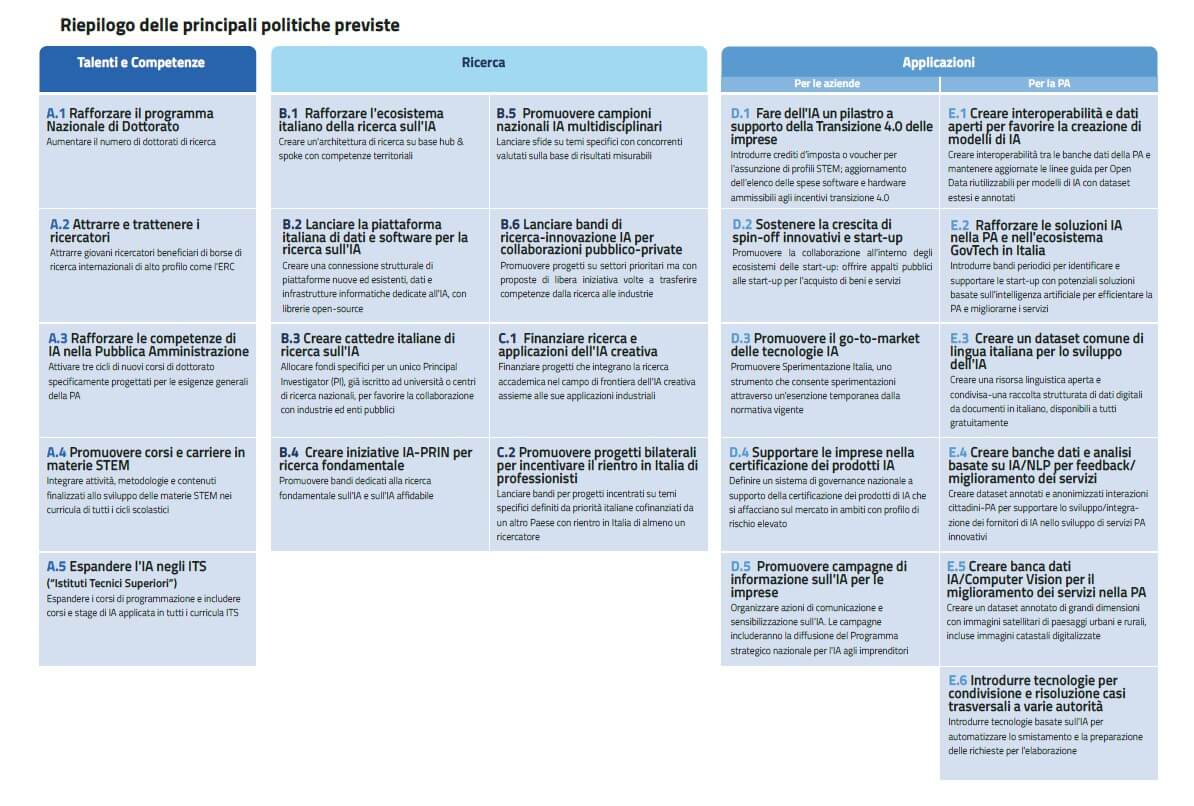

Normativa sull’AI: la situazione italiana

Il Piano Strategico dell’Italia per l’Intelligenza Artificiale 2022/2024, nel senso di quanto deciso in sede comunitaria, individua e traccia ventiquattro politiche da mettere in atto entro il 2024 ritenute fondamentali affinché il nostro Paese mantenga la competitività tecnologica a livello internazionale e trasformi i risultati della ricerca in valore aggiunto per l’industria, arrivando alle sfide tecnologiche e sociali del futuro prossimo in condizioni tali da poterle sostenere e superare.

A elaborarlo è stato un Gruppo di lavoro congiunto tra i Ministeri dell’Università e della ricerca, dello Sviluppo economico e il Ministero per l’innovazione tecnologica e la transizione digitale.

Politiche che, come si legge Comunicato stampa della Presidenza del Consiglio dei Ministri con cui il Governo dà notizia della pubblicazione Comunicato stampa del Consiglio dei Ministri n. 48 | www.governo.it, sono rivolte in primo luogo, ottimizzando gli investimenti sia nazionali che di provenienza UE in materia di AI e rendendo più solide le sinergie e le cooperazioni tra gli Stati in materia, a sviluppare le Strategie nazionali per mezzo di obiettivi, settori prioritari in cui convergeranno gli investimenti ed Aree di intervento che definiscono il modo con cui ci si propone di raggiungere gli obiettivi individuati.

Le aree d’intervento sono dirette a “rafforzare le competenze a attrarre talenti per sviluppare un ecosistema dell’intelligenza artificiale in Italia”, “aumentare i finanziamenti per la ricerca avanzata nell’intelligenza artificiale”, “incentivare l’adozione dell’intelligenza artificiale e delle sue applicazioni sia nella pubblica amministrazione che nei settori produttivi in generale”.

Piano strategico italiano per l’AI: le dichiarazioni del governo

Per il ministro dell’Università e della ricerca, Maria Cristina Messa: “…il sistema italiano della ricerca e della formazione è pronto a guidare il potenziamento di questo settore. La strategia è una straordinaria occasione di crescita competitiva. Creiamo condizioni affinché i giovani italiani, soprattutto donne, che decidono di investire in corsi di studio e nella ricerca sull’intelligenza artificiale di poterlo fare, ai massimi livelli, rimanendo nel nostro Paese…”.

Mentre per Giancarlo Giorgetti, ministro dello Sviluppo economico: “…con il Programma Strategico puntiamo a colmare il ritardo nello sviluppo e nell’adozione di soluzioni innovative in questo ambito tecnologico, dando nuovo impulso alla transizione digitale del sistema produttivo italiano. L’intelligenza artificiale è lo strumento con cui il nostro Paese nei prossimi anni vuole rafforzare l’interazione tra centri di ricerca e impresa….”.

A Giorgetti fa eco Vittorio Colao, ministro per l’Innovazione tecnologica e la transizione digitale, che aggiunge: “…la strategia è la base pe lanciare programmi e investimenti concreti per rendere l’Italia competitiva a livello internazionale e dotata di un sistema pubblico più efficiente. Prevediamo programmi di accelerazione per le start-up, che propongano soluzioni innovative per le P.a. E iniziative ad hoc per alzare notevolmente la qualità dei processi e servizi pubblici, migliorando il rapporto cittadini-Stato”.

Il sistema di governance dell’AI

Sulla base di quanto articolato nella “Proposta di regolamento COM (2021)206”, che, tra l’altro, riporta, oltre a una serie di norme per la progettazione, lo sviluppo e l’utilizzo di particolari sistemi di intelligenza artificiale ad alto rischio e restrizioni per particolari utilizzi tra cui, ad esempio, i sistemi di identificazione biometrica remota, il “Sistema di Governance” dell’AI è articolato sia a livello dell’Unione che a quello nazionale.

Si tratta, come messo in evidenza dal Governo, di un meccanismo di governance di particolare complessità, che sposterebbe sulle “Autorità nazionali – come il Governo sottolinea – una serie di responsabilità e competenze al momento difficilmente disponibili negli Stati membri”. Sarà necessario procedere a un adeguamento di competenze e professionalità che richiederà oltre che “ingenti oneri amministrativi”, tempi lunghi di attuazione.

In sede UE è prevista l’istituzione di un Comitato europeo per l’intelligenza artificiale, con il compito di facilitare l’attuazione del Regolamento e favorire la cooperazione tra le Autorità nazionali di controllo e la Commissione e di fornire consulenza e competenze all’attività della Commissione agevolando la condivisione delle best practice tra gli Stati membri.

Dovranno ancora essere istituite delle Autorità competenti che dovranno, a loro volta, garantire l’applicazione e l’attuazione del Regolamento e che disporranno di risorse finanziarie e umane adeguate alle proprie funzioni (personale permanentemente disponibile competente in materia di tecnologie, dati, calcolo, diritti fondamentali, rischi per la salute e sicurezza, etc,). Sia il Comitato europeo per la AI che le Autorità nazionali di controllo che le Autorità nazionali di controllo dovranno agire salvaguardando l’obiettività e l’imparzialità dei loro compiti e attività.

Le Autorità nazionali di controllo agiranno in qualità di Autorità di notifica e di Autorità di vigilanza di mercato e forniranno orientamenti e consulenza sull’attuazione del Regolamento. Sarà facoltà degli Stati membri istituire un “punto di contatto centrale” per la comunicazione con gli operatori.

Il ruolo di vigilanza delle istituzioni, delle agenzie e degli organismi dell’Unione in materia sarà svolto dal Garante europeo per la protezione dei dati in tutte quelle fattispecie che rientrano nell’ambito di applicazione del Regolamento.

È stata poi prevista la creazione di una banca dati a livello UE per i sistemi di AI ad alto rischio indipendenti che “presentino particolari implicazioni in relazione ai diritti fondamentali”, gestita dalla Commissione e alimentata con i dati messi a disposizione dai fornitori dei sistemi di AI, che dovranno obbligatoriamente registrare “i propri sistemi” prima di immetterli sul mercato o prima di renderli, comunque, fruibili agli utenti.

Sempre in tema di governance il Parlamento europeo ha istituito a metà dello scorso anno la Commissione speciale sul digitale e l’intelligenza artificiale, che secondo la “decisione istitutiva” è stata dotata delle seguenti attribuzioni:

- analizzare il futuro impatto dell’AI nell’era digitale sull’economia UE, in particolare in termini di competenze, occupazione, tecnologia finanziaria, istruzione, salute, trasporti, turismo, agricoltura, ambiente, difesa, industria, energia ed egovernment; esaminare ulteriormente la sfida rappresentata dalla diffusione dell’intelligenza artificiale e il suo contributo al valore delle imprese e alla crescita economica; analizzare l’approccio dei paesi terzi e il loro contributo all’integrazione delle azioni UE;

- presentare alle relative Commissioni permanenti del parlamento una valutazione che definisca gli obiettivi comuni dell’unione a medio e lungo termine e includa le fasi principali necessarie per conseguirli. A tal fine dovranno essere utilizzate quale punto di partenza le Comunicazioni della Commissione: “Plasmare il futuro digitale dell’Europa” – (COM – 2020-0067); “Una Strategia europea per i dati” (COM – 2020-0066) il “Libro Bianco sull’Intelligenza artificiale. Un approccio europeo all’eccellenza e alla fiducia” (COM – 2020- 0065); la “Relazione sulle implicazioni dell’Intelligenza artificiale, dell’Internet delle cose e della robotica in materia di sicurezza e responsabilità” (COM – 2020 – 0064).

Sistema di classificazione del rischio utilizzato dalla Commissione Europea e dall’Italia

La Commissione europea, e per derivazione, quindi, anche l’Italia, per la classificazione del rischio si basa su una “piramide di rischio” ascendente, che, cioè, va dal rischio basso/medio a quello elevato, fino al rischio inaccettabile per classificare, nell’ambito dell’AI, gli strumenti di AI che vanno a collocarsi in utilizzi specifici e settori particolari nei quali la Commissione prevede, in rapporto alla classificazione di rischio dello strumento o tecnologia di AI, “misure di attenuazione o divieti di utilizzo di alcune forme di intelligenza artificiale.

Si tratta di divieti che riguardano una serie limitata di utilizzi dell’IA ritenuti incompatibili con i valori dell’Unione Europea, in particolare quelli relativi ai diritti fondamentali contenuti nella “Carta europea”. Nello specifico si tratta di divieti relativi a sistemi di AI che “distorcono il comportamento” di una persona attraverso tecniche subliminali e sfruttando vulnerabilità specifiche che causino o possano causare danni fisici o psicologici e di divieti riguardanti l’attribuzione di un “punteggio sociale” – social scoring – mediante sistemi di AI da parte di Autorità pubbliche.

Conclusioni

Gli ultimi anni in Italia hanno visto un proliferare della produzione normativa a riguardo che hanno provato a definire tecnicamente l’AI, cercando di dare un inquadramento giuridico all’argomento. I più significativi sono: il “Libro Bianco dell’IA a servizio del cittadino” pubblicato da Agid nel 2018 che offre una panoramica iniziale del possibile impiego dell’IA per i servizi e la P.a.; il documento “AI for Future Italy”, redatto nel maggio 2020 dal Lab CINI AIIS (Laboratorio Nazionale di Artificial Intelligence and Intelligent Systems del Consorzio interuniversitario nazionale per l’informatica), che approfondisce questioni di ricerca scientifica e industriale, questioni educative e di progetti/strategie condivise tra istituzioni e industria; il Programma Nazionale per la Ricerca 2021-2027 del Ministero dell’università e della ricerca, che prevede per la prima volta uno specifico “ambito d’azione” dedicato all’AI in coordinamento ad altri settori, come ad esempio la trasformazione digitale, i big data, la robotica e la cybersicurezza; il documento: “Proposte per una Strategia italiana per l’IA”, redatto dal “Gruppo di 20 Esperti di Alto Livello” operanti al MISE e in base al quale è stata adottata nel settembre 2020 una Bozza di “Strategia Nazionale per l’intelligenza artificiale” a cui ha fatto seguito il “Programma Strategico per l’Intelligenza Artificiale – IA- 2022/2024” tutt’ora vigente.