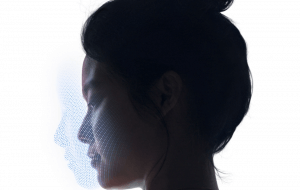

Il riconoscimento facciale è una tecnologia biometrica di nuova generazione che consente di riconoscere la nostra identità tramite i dati biometrici, definiti dall’art. 4, par. 1, n. 14, del Regolamento europeo 2016/679 (GDPR), come quei “dati personali ottenuti da un trattamento tecnico specifico, relativi alle caratteristiche fisiche, fisiologiche o comportamentali di una persona fisica e che ne consentono o confermano l’identificazione univoca, quali l’immagine facciale o i dati dattiloscopici”.

Nello specifico, abbiamo iniziato a familiarizzare con il riconoscimento facciale grazie agli smartphone di ultima generazione, i quali sfruttano questo strumento – oltre alle impronte digitali già utilizzate in passato in questo e in altri contesti – per sbloccare i dispositivi senza inserire password, ma semplicemente analizzando alcuni dettagli chiave del nostro volto, quali la distanza tra gli occhi o la larghezza del naso. Dietro questa innegabile comodità introdotta nella nostra quotidianità per la sicurezza, si celano alcuni punti critici.

Infatti, nel riconoscimento facciale ci sono certamente delle potenzialità importanti per il miglioramento delle nostre vite o della sicurezza dei dispositivi, si pensi per l’appunto alla possibilità di legare lo sblocco di uno smartphone al nostro volto impedendone l’utilizzo a soggetti terzi che, magari, avrebbero potuto intravvedere la password numerica e riutilizzarla per accedere al nostro dispositivo dopo averlo rubato o ritrovato. Tuttavia, allo stesso tempo, bisogna conoscere – e soprattutto gestire – i rischi legati a questo tipo di tecnologie che sfruttano dati particolarmente delicati come quelli biometrici.

Indice degli argomenti:

Come funziona il riconoscimento facciale

Ci sono diverse modalità attraverso le quali può essere applicato il riconoscimento facciale.

Una prima tipologia traccia e raccoglie i dati biometrici come la distanza tra le pupille, la grandezza del naso o altri dettagli facciali.

Cyber-sicurezza avanzata: manuale per la protezione dei dati critici

In alternativa, si possono analizzare i pixel del volto umano, vale a dire andare a rilevare come questi si raggruppano e si amalgamano per formare i vari elementi del viso per poi paragonare i risultati con altre immagini presenti in un database.

Una seconda tipologia di riconoscimento facciale più avanzata sfrutta il c.d. machine learning. In questo caso sono i computer che riconoscono i volti delle persone a partire da migliaia di immagini diverse conservate in un database.

Nella pratica, quindi, l’identificazione delle persone tramite il riconoscimento facciale si realizza attraverso un processo caratterizzato da una pluralità di fasi specifiche. La prima è il rilevamento: tramite dei sensori il sistema attiva le fotocamere ed effettua una foto o un video del soggetto che si trova di fronte. Dopodiché si passa all’allineamento: una volta rilevato che una persona si trova di fronte all’obiettivo, il dispositivo determina la posizione e l’inclinazione della testa, la forma e le dimensioni. Successivamente si ha la fase della misurazione: il sistema elabora l’immagine raccolta con degli algoritmi che aiutano a determinare le varie curve e insenature che formano il volto, creando così un modello del viso. La fase successiva è poi quella rappresentazione: altri algoritmi “traducono” i dettagli in un codice utilizzato per rappresentare il volto e di conseguenza la persona. La penultima fase è il confronto, nella quale il codice ottenuto viene utilizzato dal sistema per confrontare il volto con quelli già presenti nel database. Infine, si arriva all’identificazione, ossia quel momento nel quale si controlla che i volti corrispondenti ai due codici siano effettivamente lo stesso.

I rischi e sfruttamento del riconoscimento facciale

Ciò che distingue i dati biometrici dagli altri dati è che non sono modificabili. La topografia della mano, le impronte digitali o, come nel caso del riconoscimento facciale, i tratti distintivi del volto, rimangono tali per tutta la vita dell’individuo e non possono essere oggetto di formattazione o modifica.

Il tracciamento e la raccolta dei dati biometrici consentono di verificare in modo univoco l’identità di una persona. Per questo motivo, il riconoscimento facciale viene sfruttato in vari settori, sia pubblici che privati. Per fare un esempio, basti pensare alle attività di polizia, dove il riconoscimento facciale è utile per rintracciare in modo molto più veloce ladri, criminali, ma anche persone scomparse o, addirittura, per identificare dei cadaveri.

Ancora, il riconoscimento facciale, ad esempio, può arrivare a far conoscere i tratti della personalità della persona, rivelandone i sentimenti o lo stato di salute mentale. Si tratta di un utilizzo che potrebbe essere ingiustamente sfruttato in vari contesti, come nelle procedure di assunzione.

A ciò si aggiungano i rischi che caratterizzano il trattamento tutti i dati personali, ma che nel caso dei dati biometrici possono portare a conseguenze particolarmente gravi – in modo particolare il furto, visto che, come si è evidenziato, se un soggetto non autorizzato entra in possesso di dati biometrici come, ad esempio, l’impronta digitale utilizzata come password per uno smartphone, non sarà possibile far fronte ai rischi derivanti da questa attività illecita semplicemente modificando il dato stesso.

Secondo una ricerca effettuata nel 2019 da Kaspersky, azienda operante nel settore della sicurezza informatica, ben quattro computer su dieci, fra quelli usati per elaborare i fattori di autenticazione fisica, sono stati presi di mira da malware. Circa il 40% dei server e postazioni di lavoro che raccolgono tali dati ha subito almeno un tentativo di infezione veicolato da trojan per accesso remoto, trojan bancari e ransomware. Alla luce di quanto detto sopra, non sorprenderà sapere che lo scopo delle aggressioni è quello di sottrarre impronte digitali, geometrie di mani o volti, la voce stessa o l’iride di ignari utenti.

Da ultimo, ma di certo non per importanza, il tema del trattamento dei dati biometrici è inscindibile dal concetto di dignità umana. In effetti, l’utilizzo di questa tipologia di dati può arrivare fino a oltrepassare i confini dei diritti umani quando vengono utilizzati per scopi di sorveglianza di massa, discriminazione o selezione.

L’utilizzo del riconoscimento facciale: tra sicurezza e diritti umani

Come introdotto in conclusione del paragrafo precedente, la questione relativa al trattamento dei dati biometrici, quali appunto quelli raccolti con riconoscimento facciale, è anche e soprattutto una questione di equilibrio tra sicurezza e diritti umani.

In effetti, i dati biometrici vengono utilizzati in diversi ambiti con la funzione di aumentare il livello di sicurezza di strutture o dispositivi. Il riconoscimento facciale sugli smartphone non è che una piccola parte di questo processo.

Cosa succede in Italia

In Italia gli aeroporti di Roma Fiumicino, Ciampino e di Milano Linate si sono allineati ad altri aeroporti internazionali introducendo, di recente, un sistema sperimentale che rileva i dati biometrici del volto e li incrocia a quelli derivanti dalla scansione della foto del passaporto.

Allo stesso modo, molti parcheggi sfruttano le immagini delle telecamere intelligenti dei sensori per controllare gli spazi liberi o occupati all’interno di un parcheggio. In questo caso le telecamere non registrano immagini né ritraggono visi o targhe, proprio per garantire la tutela della privacy.

Anche alcuni hotel fanno uso del riconoscimento facciale, quando tra i propri ospiti ci sono personaggi famosi, in modo da tutelarne la sicurezza durante il soggiorno: vengono utilizzate telecamere intelligenti che hanno lo scopo di raccogliere i dati biometrici del VIP per riconoscerlo in modo univoco (ed ovviamente ciò è subordinato al consenso del personaggio in questione).

I dispositivi che rilevano dettagli facciali vengono poi usati anche per scopi di polizia, contrasto al crimine o per l’accesso a luoghi particolarmente sensibili, anche qui per aumentare la sicurezza.

Questi sono solo alcuni esempi di come il riconoscimento facciale possa essere uno strumento utile per l’incremento della sicurezza. I problemi, però, nascono con gli abusi di questo sistema per esercitare forme di sorveglianza di massa, di selezione o di repressione che ledono la privacy e altri diritti dell’uomo generando gravi forme di ingiustizia.

Innanzitutto, c’è il tema del bias dei sistemi di riconoscimento facciale, che vengono addestrati a riconoscere i volti delle persone studiando una serie di fotografie: se il campione di base è poco eterogeneo (ad esempio non ci sono abbastanza donne o abbastanza persone di colore), allora c’è la possibilità che vi siano dei falsi positivi tra i risultati. Soprattutto quando si parla di minoranze etniche, in quanto questi sistemi hanno riconosciuti bias di genere, etnici e razziali verso le persone di colore e le donne. Le conseguenze non sono di poco conto: significa, ad esempio, che una persona può essere identificata ingiustamente come protagonista di un crimine e perseguita senza ragione.

Cosa succede nel resto del mondo

Per citare un esempio, a gennaio 2020 un cittadino statunitense è stato arrestato per errore dopo che la polizia del Michigan aveva riconosciuto il suo volto durante un furto risalente all’ottobre 2018: l’uomo è stato detenuto per molto tempo prima che l’interrogatorio rivelasse che era la persona sbagliata.

A Hong Kong, molti manifestanti sono scesi in strada a favore della democrazia e contro le tecniche di sorveglianza governativa, abbattendo i lampioni smart, vale a dire dotati di sistemi di videosorveglianza con riconoscimento facciale. Ed è proprio a Hong Kong che l’utilizzo di questa tecnologia è aumentato vertiginosamente diventando un vero problema sociale, il quale innesca manifestazioni con decine di migliaia di persone, per il contrasto delle quali si usano proprio tecnologie di riconoscimento facciale. Un cane che si morde la coda in una spirale di violenza e compressione dei diritti umani.

Senza allontanarsi molto, in Cina si parla di un vero stato di sorveglianza globale. La possibilità di acquistare beni con il proprio volto appare come il male minore davanti ad altri utilizzi. Si pensi ai particolari occhiali intelligenti in dotazione alla polizia che usano il riconoscimento facciale per individuare sospetti criminali, o l’utilizzo della tecnologia in questione per individuare le persone che attraversano con il semaforo rosso. Il problema più drammatico riguarda però l’applicazione di queste tecnologie per fini di discriminazione: il riconoscimento facciale viene utilizzato in Cina per monitorare le attività dei musulmani uiguri, una minoranza religiosa.

Negli Stati Uniti sono sempre di più i dipartimenti di polizia che aspirano a utilizzare il riconoscimento facciale o a incrementarne le possibilità, ma ciò che più preoccupa sono i bias razzisti e di genere, particolarmente contestati dalle organizzazioni che si occupano di diritti civili e politici, soprattutto alla luce dei fatti di cronaca aventi ad oggetto le morti di cittadini afroamericani durante procedure di controllo o di arresto delle forze dell’ordine, nonché come conseguenza delle successive proteste.

Ad alimentare le speranze degli attivisti, però è un fatto risalente all’ottobre 2020: con un voto all’unanimità, la giunta municipale della metropoli di Portland, nell’Oregon, ha vietato l’utilizzo del riconoscimento facciale nel settore pubblico o privato, unendosi a un numero crescente di città statunitensi che stanno vietando l’uso di particolari tecnologie di sorveglianza, tra cui San Francisco, Oakland e Boston.

Conclusioni

L’evoluzione tecnologica è inarrestabile e probabilmente opporvisi sarebbe poco utile, se non dannoso. In effetti, occorre tenere ben presenti i vantaggi derivanti da questo tipo di evoluzione, nonché i miglioramenti che possono essere apportati alla vita quotidiana, all’esercizio della professione o alla tutela dell’ordine pubblico.

Nel caso di specie, l’introduzione del riconoscimento facciale e delle altre tecnologie di trattamento dei dati biometrici, è senza dubbio un modo per rafforzare sistemi di sicurezza, andando in modo particolare a sostituire strumenti più risalenti come le password o varie tipologie di codici. Si pensi, ad esempio, alla possibilità di accedere a dati bancari mediante i dettagli del volto o di entrare in luoghi privati come la casa o l’azienda con le impronte digitali. Le stesse considerazioni possono valere per l’utilizzo di questi strumenti nella tutela della sicurezza pubblica.

Non c’è dubbio che la possibilità di tracciare una sorta di “mappa” del volto umano, confrontarla e arrivare a identificare un sospettato, sia in astratto un’arma molto potente ed efficace nelle mani delle forze dell’ordine.

Qui però sorgono la maggioranza delle questioni principalmente legate, come abbiamo visto sopra, al fatto che questi sistemi non siano ancora perfetti e che i loro difetti potrebbero portare a conseguenze spiacevoli per la giustizia e l’uguaglianza. Si veda il caso dei bias razzisti, così come l’ipotesi di arresti conseguenti a scambi di persona. Quest’ultimo aspetto potrebbe capitare anche senza l’utilizzo del riconoscimento facciale, certo, ma se da un lato ci si aspetta che queste tecnologie così avanzate servano ad evitare questo tipo di errori, e non a contribuirvi, dall’altro è anche vero che molti arresti errati si sarebbero potuti evitare con una semplice supervisione umana – come dimostra il caso concreto citato sopra, in cui il disguido è divenuto immediatamente palese nel momento dell’interrogatorio.

Inoltre, i tentativi – alcuni dei quali riusciti – di rubare i dati biometrici tramite attacchi cyber, evidenziano alcune criticità legate alla sicurezza di tali dati. In questo caso, le conseguenze sono ancor più gravi dei furti di password, e ciò per le ragioni precedentemente citate: i dettagli del viso o le impronte digitali non sono modificabili con qualche “click”.

Infine, ed è ciò che racchiude in sintesi le osservazioni finora esposte, con il riconoscimento facciale siamo di fronte a un problema di equilibrio tra sicurezza e diritti umani. La sorveglianza di massa, la selezione del personale, l’identificazione dell’etnia o del genere, sono tutti elementi che vanno a toccare le corde dei diritti fondamentali: la riservatezza, l’uguaglianza, la libertà.

I diritti umani rimangono il cuore pulsante di qualunque società, e ci auguriamo che le nuove tecnologie siano sempre strumenti dell’uomo per migliorare le vite di ciascuno nei settori più disparati, e non strumenti volti invece a rinforzare il controllo arbitrario e quindi la compressione delle libertà.

Il confine tra sicurezza e diritti umani risiede proprio nella coscienza con la quale sfruttiamo queste conquiste nuove senza arrecare danni alle conquiste del passato.

Guida completa al SOC As a Service: cos'è e come funziona