È stato pubblicato da parte di Assinform (Associazione Italiana per l’Information and Communication Technology) il White paper “L’IA a tre dimensioni”, allo scopo di fornire un quadro completo e strutturato relativamente ai programmi di sviluppo che hanno a oggetto l’intelligenza artificiale, alla normativa in corso di approvazione, ed alle principali esperienze avute in campo aziendale che coinvolgono le AI.

Punto focale del documento è il valore che l’intelligenza artificiale consente di creare dai dati, divenendo un vero e proprio “strumento infrastrutturale”, fondamentale per consentire lo sviluppo del tessuto imprenditoriale nazionale.

Ecco una sintesi dei principali punti affrontati nel paper, con particolare riferimento alla normativa sul tema.

White paper Assinform: l’AI come strumento

L’indagine condotta da Anitec-Assinform su di un campione di imprese – non rappresentativo – ha portato a concludere che, per la maggior parte delle imprese che hanno integrato sistemi fondati sull’intelligenza artificiale (AI) nei propri processi produttivi:

- L’AI è diventata uno strumento operativo, parte integrante e necessarie di molteplici linee di prodotto e attività;

- L’AI viene utilizzata anche come strumento per lo sviluppo di software, o come elemento a valore aggiunto che consente ad un prodotto di distinguersi dai concorrenti e fornire maggiori funzionalità;

- L’AI viene spesso acquisita “embedded”, ossia mediante strumenti forniti da terze parti, al fine di efficientare i processi aziendali e lo strumento stesso: poche aziende, infatti, sono dotate delle competenze necessarie per poter sviluppare l’AI in-house;

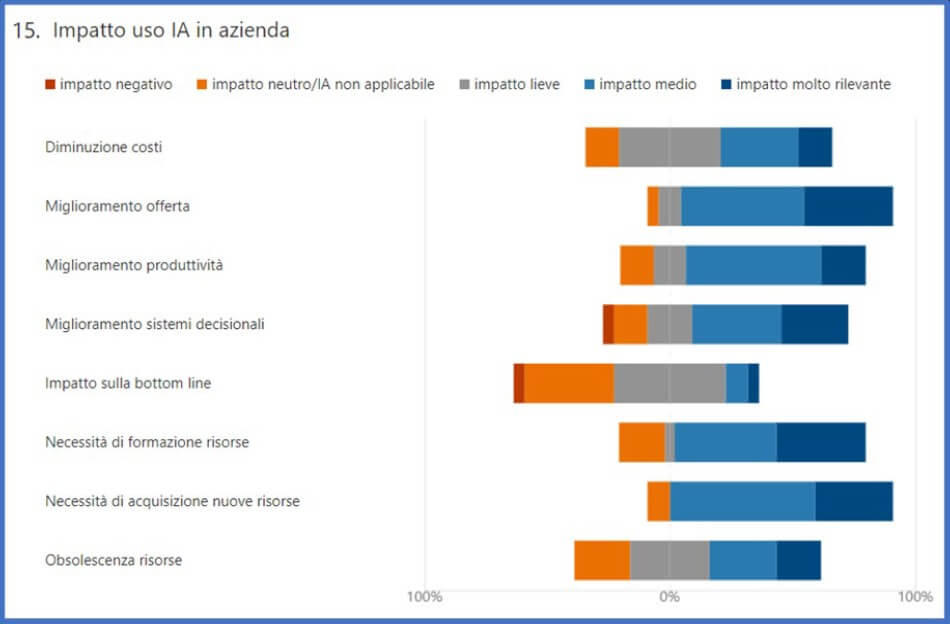

- L’impatto sulla “bottom line” è ancora particolarmente scarso, anche se si prospetta un miglioramento progressivo dell’offerta nel futuro;

- L’introduzione dell’intelligenza artificiale nei processi aziendali impatta sulle risorse umane e sulle competenze che l’azienda deve acquisire, con conseguente incremento della domanda di formazione sul tema e di risorse da inserire in azienda;

Relativamente a quest’ultimo punto, in particolare, si rileva come molte aziende manchino delle competenze necessarie non solo a sviluppare le AI, ma anche a gestirne i copiosi flussi di dati, sia in entrata che in uscita. Ne consegue, sul mercato del lavoro, un incremento repentino della domanda di AI Skills e di formazione in intelligenza artificiale, anche all’interno delle PMI, di cui il tessuto italiano è prevalentemente composto.

“A livello globale”, affermano i ricercatori, “si stanno confrontando diversi approcci alla governance dell’AI, alcuni sono più business-oriented, altri lo sono meno. In questo quadro l’evoluzione tecnologica spinge verso la nascita di un’AI infrastrutturale ossia fatta di oggetti connessi che interagiscono tra loro, apprendono continuamente dal contesto che li circonda e arrivano a influenzarlo”. Tuttavia, nelle aziende “l’IA fatica ad affermarsi del tutto. Chi offre soluzioni di Intelligenza artificiale deve confrontarsi con un mercato del lavoro incapace di offrire competenze sempre adeguate, con una data economy ancora inefficiente e con una domanda non ancora matura”.

L’indagine Assinform mostra, più nello specifico, un mercato italiano dell’AI dal valore di 330 milioni di euro (circa il 4,5% del mercato europeo), in ritardo nonostante un tasso di crescita medio del 22% tra il 2022 e il 2024: “una causa di questo ritardo”, si legge nel documento, “va individuata nella scarsa adozione dell’AI nelle PMI: solo il 6% di queste ha avviato progetti di intelligenza artificiale nell’ultimo anno”.

Proprio al fine di dimostrare come l’intelligenza artificiale (AI) possa costituire un valore aggiunto per le PMI, il paper di Assinform fornisce, nella sezione finale, una serie di casi d’uso che dimostrano “come le possibilità di utilizzo dell’intelligenza artificiale siano vaste e come la tecnologia possa impattare sui business”.

White paper Assinform: l’AI in Italia

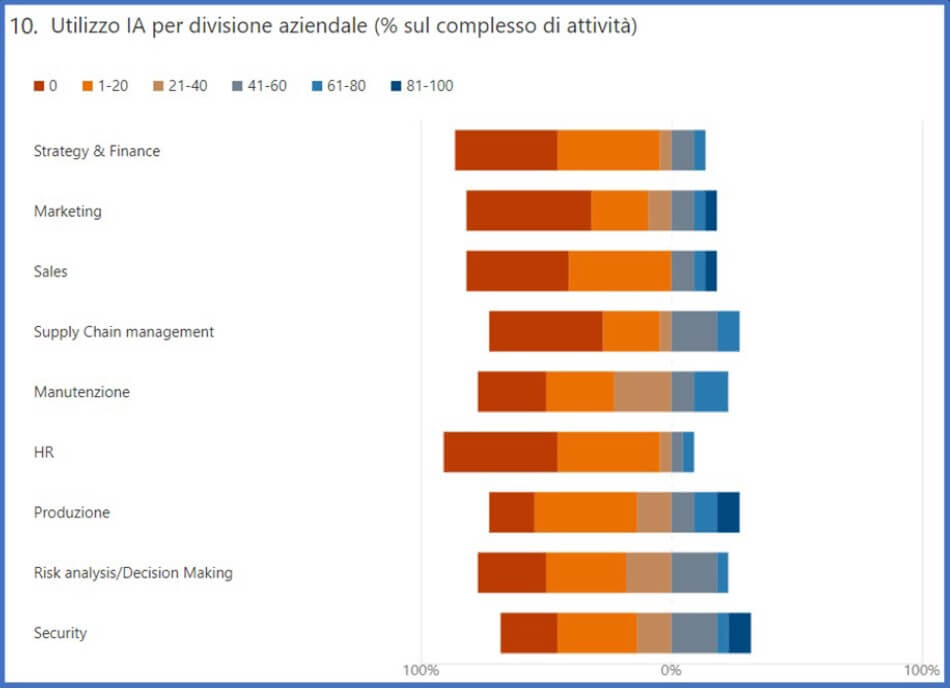

Dalla ricerca sulla AI condotta da Anitec-Assinform emerge inoltre che:

- Le funzioni dove l’AI è maggiormente impiegata sono «Security», «Produzione» e «Supply Chain management», mentre l’area Human Resources risulta essere quella dove l’AI è meno impiegata.

- Per quanto riguarda i software utilizzati, l’81% dei rispondenti indica di utilizzare strumenti Cloud o Software as a Service. Molto rilevanti anche i software sviluppati in house (72%) e gli open-source (50%). Risultano invece poco diffuse le soluzioni off-the-shelf (13% del campione).

- Il mercato ha avuto un ruolo di stimolo determinante per spingere le aziende ad adottare soluzioni di AI, al fine di migliorare il proprio posizionamento rispetto ai competitor, sia nazionali che internazionali.

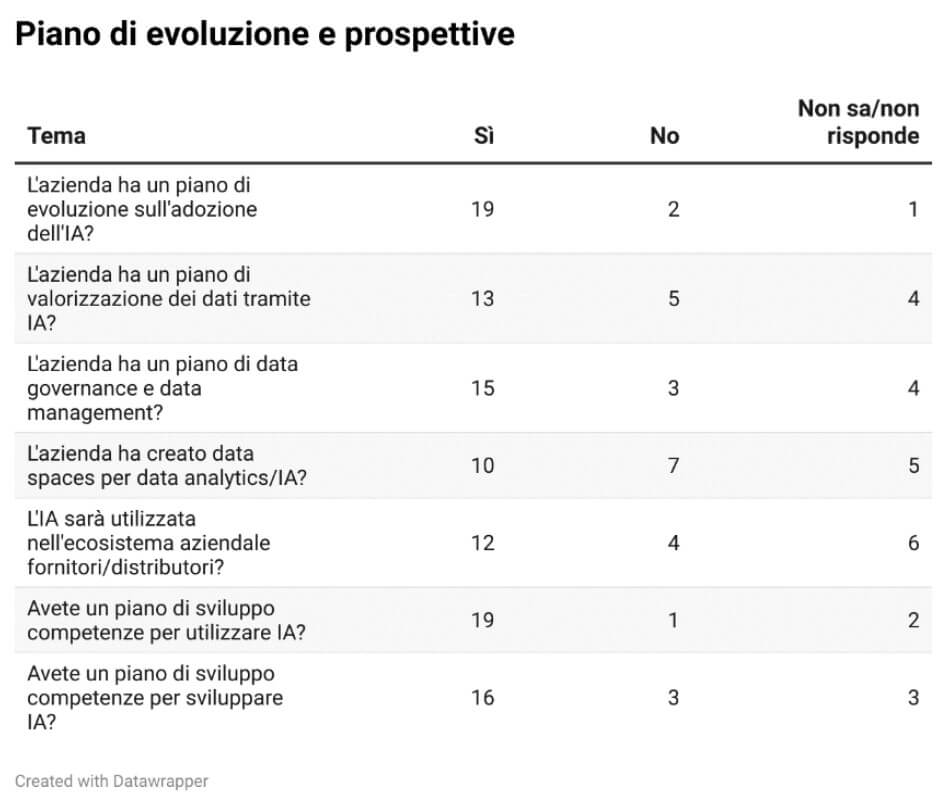

- la quasi totalità del campione ha un piano di evoluzione sull’adozione dell’AI e un piano per lo sviluppo di competenze per utilizzarla. L’86% del campione ha dichiarato che il proprio budget per l’AI aumenterà nei prossimi tre anni.

- Non si prioritizza la creazione di data space.

In relazione, poi, agli ostacoli all’adozione e sviluppo di AI, “le aziende si sono mostrate concordi nell’indicare l’insufficiente qualità dei dati (o addirittura l’indisponibilità di questi) e la mancanza di skill adeguate nel mercato del lavoro, come le principali difficoltà per l’utilizzo e lo sviluppo di intelligenza artificiale in azienda. Al contrario il contesto regolativo non è quasi mai percepito come ostativo”.

Fonte Assinform-Anitec

La normativa sull’AI

La rilevanza dell’AI all’interno del settore produttivo ha comportato, da parte dei legislatori, una crescita d’interesse e la necessità di regolamentare i possibili utilizzi delle intelligenze artificiali – sia in ambito privato che pubblico. Negli ultimi 5 anni, in particolare, si è assistito a una proliferazione, a livello internazionale, delle strategie nazionali per l’intelligenza artificiale.

“Secondo l’Artificial Intelligence Index 2021 Annual Report dell’Università di Stanford”, si legge, “nel 2017 si contavano solo cinque strategie nazionali per l’Intelligenza Artificiale (sviluppate da Canada, Cina, Giappone, Emirati Arabi Uniti e Finlandia). A dicembre 2020 ne erano state pubblicate 32 da altrettanti paesi e 22 erano in corso di sviluppo. Nel 2022 l’osservatorio AI dell’OCSE conta 700 iniziative di policy raccolte nelle strategie AI di oltre 60 paesi (compresa l’UE). Questi dati danno la dimensione di quanto la governance (inteso sia come stimolo che come regolazione) dell’AI si sia affermato al centro delle agende politiche dei governi di tutto il mondo negli ultimi anni”.

SI tratta di strategie che hanno un impatto sia sulla produttività e sulla crescita industriale delle imprese, che sulla geo-politica, andando a definire standard, utilizzi ed elementi fondamentali delle AI.

Cina

Più nel dettaglio, la Cina ha focalizzato la propria attenzione sulla creazione di un sistema nazionale a elevata produttività più sviluppato rispetto a quello sinora adottato, oltre che sull’introduzione di una regolazione interna sugli algoritmi di Intelligenza Artificiale, che è entrata in vigore a marzo del 2022. La misura “riguarda principalmente i sistemi di AI che suggeriscono contenuti agli utenti (algorithmic recomendations). Gli utenti possono scegliere di non essere soggetti a pubblicità mirate (targeted) ed è stato osservato come questa misura sia affine all’AI Act europeo e abbia un’ispirazione human-centric”;

Giappone

Il Giappone ha posto la sua strategia sull’AI nel contesto dell’obiettivo Society 5.0, per evidenziare che l’intelligenza artificiale è destinata a cambiare la società intera, e non solo l’industria. L’obiettivo è anche quello di industrializzare l’AI, aumentando la produttività. “Come aree primarie di applicazione sono indicate quelle della sanità (sia ospedaliera sia ambulatoriale – le due maggiori voci di spesa nel settore) e dell’information security. La strategia prevede: il coinvolgimento di pubblico e privato; interventi per rafforzare l’insegnamento di materie “STEM e Digital” nelle scuole superiori e all’università; supporto alla ricerca pubblica e privata; infine, la “social implementation”, cioè la creazione di una cultura che veda l’AI come soluzioni e servizi a supporto delle persone nella vita di tutti i giorni.”

Italia

In Italia, l’AI è stata oggetto del Programma Strategico Nazionale, oltre che di un tentativo di definire una policy per l’IA nel 2020. Come evidenziato nel paper Assinform sull’AI, si tratta di due documenti pubblicati in contesti differenti, connessi al PNRR e alla Proposta di Regolamento UE avanzata dalla Commissione Europea ad Aprile 2021. Nel “Programma”, in particolare, vengono delineati i “principi guida, gli obiettivi strategici e le politiche (e per molte di queste le relative possibili coperture finanziarie) da adottare per rafforzare l’ecosistema italiano dell’IA”. Sono sei gli obiettivi che l’Italia si pone, da raggiungersi mediante ben 24 diverse politiche ad hoc (negli ambiti talento e competenze, ricerca, applicazioni): “i primi due sono relativi alla ricerca (rafforzamento e coordinamento), vi è poi lo sviluppo di un’AI human-centered (in linea con i principi delineati a livello UE), lo sviluppo di AI nel sistema produttivo italiano, i servizi basati sull’AI nel settore pubblico (GovTech) e il rendere il Paese attrattivo per talenti e ricercatori del settore.” I settori cui si darà priorità sono “Industria e manifatturiero”, “Sistema educativo”, “Agroalimentare”, “Cultura e turismo”, “Salute e benessere”, “Ambiente, infrastrutture e reti”, “Banche, finanza e assicurazioni”, “Pubblica Amministrazione”, “Città, aree e comunità intelligenti”, “Sicurezza nazionale”, “Tecnologie dell’informazione”.

Usa

In Usa, poi, l’AI (regolamentata dal National AI Initiative Act del 2021) è al centro di numerosi investimenti in ricerca e applicazioni, e viene introdotta anche nel percorso di scolarizzazione, al fine di presentare sul mercato delle figure professionali competenti per il futuro. “La strategia”, si precisa, “è nata anche dalla preoccupazione di vedere la leadership nella AI spostarsi dagli USA alla Cina e questo si riflette nella scelta di impegnare importanti fondi federali nell’attività di ricerca e sviluppo”.

L’AI Act Europeo

In Europa, l’intelligenza artificiale è oggetto di una proposta di regolamento ad hoc, che rappresenta un tassello fondamentale della complessiva strategia europea sulla regolamentazione delle tecnologie digitali, insieme al Data Governance Act e al pacchetto Digital Finance in tema di criptovalute e blockchain.

Anche in questo caso, si tratta di una normativa che, come evidenziato nel Paper, “va letta nell’ottica di una regulation race globale tra USA, UE e Cina in cui l’Europa cerca di affermare il suo approccio human-centered, “etico” e pragmaticamente basato sul rischio, come terza via tra il laissez-faire statunitense e il capitalismo di stato cinese”. Obiettivo fondamentale, infatti, è quello di rendere l’IA una tecnologia sicura, degna di fiducia e che ponga al centro la persona umana e la sua dignità, evitando pericolose discriminazioni.

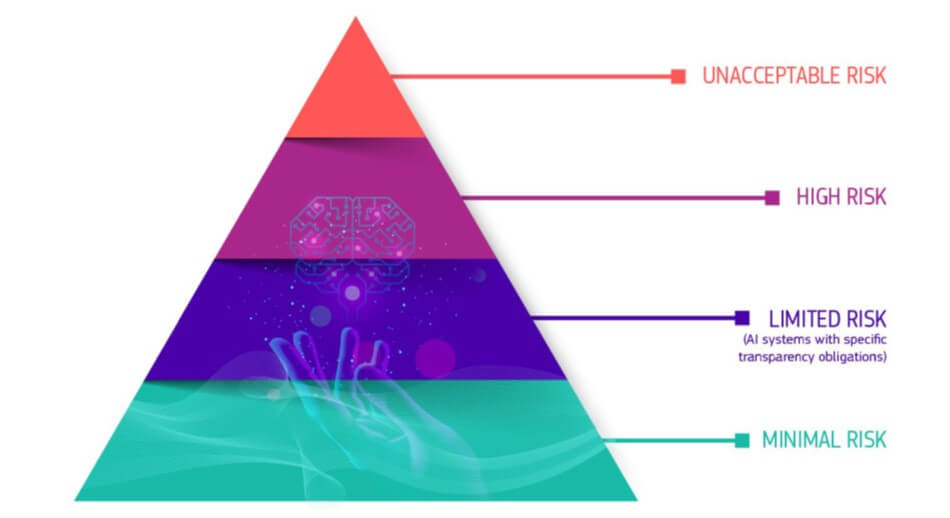

Viene, pertanto, resa una definizione – per quanto possibile – di cosa sia un’AI, e introdotto un meccanismo ex ante di certificazione preventiva dell’AI, fondato su requisiti progressivamente più stringenti, man mano che aumenta il rischio connesso all’applicazione della stessa.

La definizione scelta, per ora, è particolarmente estesa, anche se è ancora aperto un dibattito sul tema: alcuni dei regolatori, infatti, preferirebbero optare per una definizione meno generale, riferita a specifici usi. Il pericolo, tuttavia, è che si creino dei pericolosi vuoti normativi, che renderebbero la normativa obsoleta sin dalla sua nascita, e inadatta al contesto, o che una definizione poco definita incida sui costi di compliance regolatoria per aziende e sviluppatori.

Ulteriore elemento fondamentale della proposta avanzata dalla Commissione è il sistema di classificazione delle AI, fondato su quattro livelli di rischio: minimo, limitato, alto, o inaccettabile (nel caso in cui l’AU sia utilizzata per scopi contrari ai diritti fondamentali dell’UE, come la manipolazione del comportamento, o l’utilizzo di sistemi di identificazione biometrica in tempo reale).

Per le applicazioni ad altro rischio, cui viene dedicato un intero capo della proposta, viene richiesto di essere conformi “alle disposizioni di cui agli artt. 9-15 della proposta di Regolamento (riguardanti, i dataset per il training, sistemi di risk management, documentazione tecnica, sorveglianza umana ecc.). Il rispetto degli standard richiesti per le AI ad alto rischio si sostanzia nella previsione del marchio CE per questo tipo di sistemi (art. 49)”. Si tratta di una procedura particolarmente complessa, vista come un punto critico dai ricercatori, in quanto richiederà costi non indifferenti per poter essere ottenuta.

I ricercatori rilevano, tuttavia, che la maggior parte dei sistemi di AI ricadrà nelle categorie a rischio limitato (per i quali si prevedono solo obblighi di trasparenza nei confronti dell’individuo che vi interagisce) e a rischio minimo. “Le intelligenze artificiali classificabili in tale categoria di rischio sono quelle che:

- interagiscono con gli umani (es. chatbot)

- sono utilizzate per rilevare emozioni o determinare associazioni con categorie sociali basandosi su dati biometrici,

- generano contenuti manipolativi (es. deep fake)”.

Fonte: Assinform-Anitec

Nella proposta si prevede anche l’istituzione di misure volte a stimolare l’innovazione: “Gli articoli 53 e 54 prevedono delle regulatory sandbox per sviluppare intelligenze artificiali, mentre l’articolo 55 reca disposizioni di supporto per piccole e medie imprese e start-up. Le sandbox regolatorie nel disegno dell’AI Act vengono istituite dalle autorità nazionali competenti e hanno lo scopo di creare uno spazio controllato che faciliti lo sviluppo, la sperimentazione e la validazione di sistemi di intelligenza artificiale innovativi. In generale, la proposta di Regolamento non è particolarmente dettagliata su questo tema e affida i dettagli dell’implementazione ad atti esecutivi di livello più basso”.

Nulla viene previsto relativamente alla formazione, sebbene rappresenti un tema da affrontare necessariamente, includendo iniziative come “istituire in framework per la validazione uniforme in Europa delle competenze relative all’AI, potenziare le competenze digitali di base nella popolazione in modo da ridurre la diffidenza nei confronti dell’intelligenza artificiale e il supportare le politiche di formazione continua per la forza lavoro attualmente occupata”. Anche per rispettare gli obblighi di trasparenza è necessario che l’utilizzatore sia formato, in quanto sarà chiamato a rispondere del prodotto che sarà costruito.

White paper Assinform: l’AI nell’industria

All’interno del paper di Assinform si rileva come l’intelligenza artificiale sia stata sviluppata principalmente per rispondere a esigenze specifiche e localizzate. “In campo industriale, ad esempio, si utilizza l’analisi (streaming nei sistemi più recenti) di immagini delle fasi di lavorazione per il controllo di qualità di una linea di produzione. Allo stesso tempo, attraverso sensori ambientali incorporati nel ciclo di produzione – e nel prodotto finale – aumenta in modo esponenziale il flusso di dati provenienti dalla catena produttiva. La raccolta, l’indicizzazione e la conservazione di questi dati alimentano il data lake storico del processo (thread) e rappresenta un asset strategico per l’impresa, anche in ottica di landing verso data space di prossima costituzione. I dati raccolti possono essere analizzati con strumenti di machine learning per ottimizzare i processi di produzione”.

Le soluzioni di machine learning, in particolare NLP (Natural Language Processing) e OCR (Optical Character Recognition), consentono di inserire l’AI all’interno dei più svariati processi aziendali, dando vita a soluzioni di robotica di processo (RPA, Robotics Process Automation) particolarmente rilevanti, legate non solo all’analisi dei dati di utilizzo dei prodotti.

Emergono, più nel dettaglio, una serie di possibilità:

- ottimizzazione e resilienza della supply/delivery chain, mediante “una crescente softwarizzazione (engine as a service) del veicolo in cui l’AI diventa un componente fondamentale per assicurare flessibilità e resilienza”.

- Creazione di awareness di contesto nei prodotti/servizi, grazie alla maggiore efficacia delle interazioni con l’esterno e il miglioramento delle reazioni: “i prodotti sono in grado di rendersi conto (awareness) del contesto in cui operano e adeguano le risposte sulla base di una valutazione del successo (metrica predefinita) conseguito a una specifica risposta […]. Dal punto di vista dell’impresa, adottare questo tipo di intelligenza nei prodotti significa diminuire i costi (l’adattamento al contesto è fatto autonomamente dal prodotto stesso) e aumentare la soddisfazione del cliente (che si trova ad avere un prodotto personalizzato e che si evolve nel tempo in base alle necessità)”.

- Creazione di awareness locale su base globale: l’inserimento dei prodotti in un contesto di rete, consente di elaborare una awareness globale che può essere riportata a livello locale aumentando la capacità di analisi e di decisione.

- Creazione di intelligenza a partire da intelligenza infrastrutturale: la diffusione di microsistemi intelligenti – spesso embedded – apre alla possibilità, in un futuro prossimo, di creare una rete di componenti AI in cloud condivisibile da terze parti e data space, che rende più semplice, per le imprese, adottare e sviluppare delle AI customizzate alle loro esigenze e ne aumenti la competitività.

Fonte Assinform-Anitec

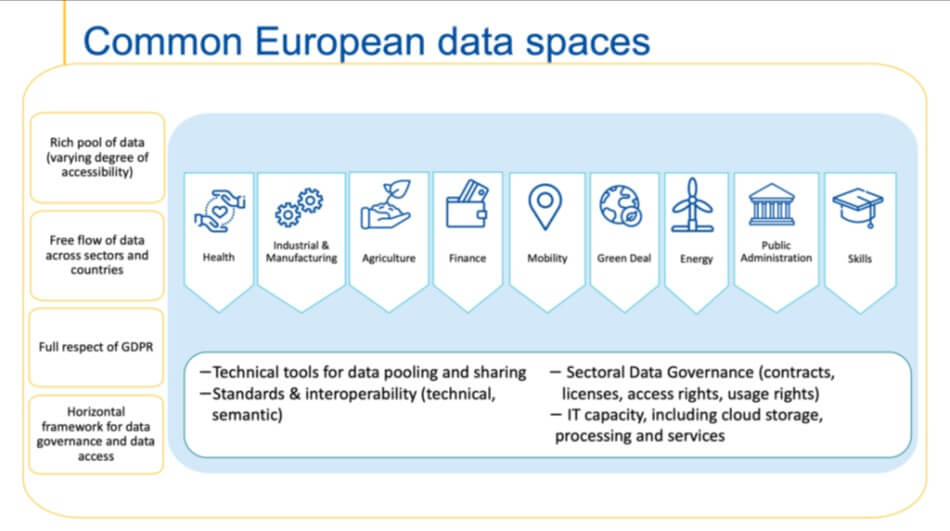

I Data Space europei

Proprio in relazione alla creazione di un’intelligenza infrastrutturale, ci si propone, all’interno della Strategia Europea sui dati, di creare dei data space verticali. “L’obiettivo è quello di armonizzare i sistemi di governance dei dati e, allo stesso tempo, costruire un’infrastruttura transfrontaliera. La Commissione europea ha individuato i principi guida per la progettazione dei Common European data space: controllo sui dati, rispetto dei valori e delle regole dell’UE, infrastruttura tecnica comune, interoperabilità, opennes intesa come apertura alla partecipazione di tutti gli attori (organizzazioni o individui) che rispettano i valori e le regole dell’Unione.”

Inoltre, si continua a lavorare alla creazione di un Cloud Europeo per la Scienza Aperta (EOSC), che garantisca “a ricercatori, innovatori, imprese e cittadini europei l’accesso diretto ai dati e un loro riutilizzo affidabile, mediante un ambiente di dati distribuito e aperto.”

Fonte Assinform-Anitec